安全人工智能市场机遇和格局

自 ChatGPT 出现以来,企业中的 AI 部署和新的 AI 初创企业以惊人的速度增加,加剧了由于经济衰退和 AI 竞赛所需的生产力增长的需求。

ChatGPT激发科技投资者在2022年向人工智能初创公司投入了600亿美元。此外,最近的一项Gartner调查发现,2500名高管中有45%因ChatGPT而增加了对人工智能的投资,70%的高管正在探索他们的组织中的生成式人工智能,而19%处于试点或生产模式。

在这样的背景下,斯坦福人工智能安全中心在他们的白皮书中得出结论,许多编写这些人工智能程序的程序员甚至都不知道AI的特点。

除了OpenAI之外,Anthropic是最大的人工智能投资之一,其整个论题是AI系统可能与人类价值观不一致,因此,采用实证方法构建安全AI。

这是人类论文:

“如果我们建立了一个比人类专家更具有能力的AI系统,但它追求的目标与我们的最佳利益相冲突,后果可能是灾难性的。这就是技术上的对齐问题...在非常强大的AI系统被创建出来之前,最悲观的场景可能看起来像乐观的场景。”

因此,人类学公司正在构建第一个宪法人工智能,这是一个自主管辖的人工智能系统,不需要人类介入即可改进模型。通过宪法人工智能,人类学可以进行可伸缩的监督,观察人工智能系统如何对负面输入做出反应,并且如果存在负面输出,则训练人工智能变得更加诚实可靠。

有许多与常用人工智能模型相关的负面影响,这些模型依赖于人类输入所建立的反馈循环。这些模型可能会放大源自AI设计师和输入人员的偏见。

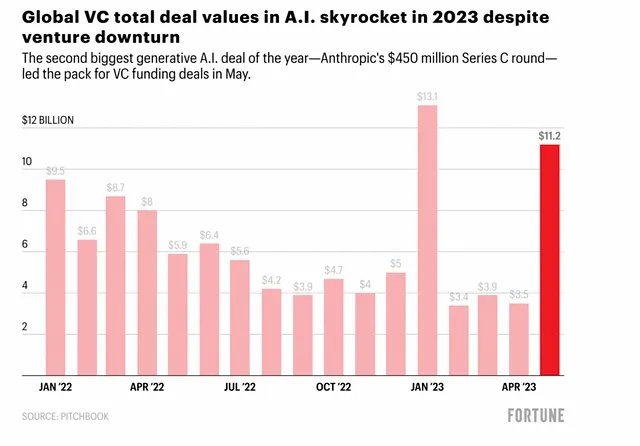

术语表格2023年6月的通讯显示,尽管全球风险投资交易价值下降,但人工智能全球交易规模正在上升。

全球人工智能 (AI) 市场规模在2022年达到了67412.73 万美元,并预计在预测期间以39.73% 的复合年增长率扩张,到2028 年达到 501813.57 万美元。

因此,将有巨大的市场机会供初创企业处理快速人工智能部署的后果。由于在没有适当保障的情况下加速采用人工智能,可能会出现三种类型的初创企业,这是未来三种情况的结果。

- 初创公司咨询其他公司,以安全地实现人工智能。目前咨询公司如BCG致力于帮助企业安全地实现负责任的人工智能。

- 帮助企业/机构处理实施AI带来的负面后果的创业公司。例如,美国一所学校实施了人工智能来评估教师,结果,该人工智能将该学校的一名杰出教师解雇了。这名教师非常出色,不符合平均水平,因此人工智能认为她必须被解雇作为后果。

- 处理人工智能作为国家安全威胁的初创公司(例如:Anthropic)。

我认为很多人没有认真对待人工智能安全问题,因为许多论文和新闻只谈到了第三种情况,即人工智能变得如此危险,以至于导致人类灭绝。然而,如果没有适当的风险措施,人工智能的部署可能会导致灾难性后果,这些情况并不那么牵强。

由于人工智能市场规模非常巨大,应对快速发展后遗症的安全人工智能初创公司(如Anthropic)的新兴领域潜力是指数级的。

或者,这也可以通过政府与人工智能专家合作设计防护栏和保障措施,来实现安全的人工智能实现方式。

此外,未来需要考虑的问题是谁应该对人工智能的后果负责。例如,在情景2中,发明人还是决定实施人工智能的人应该被追究责任?这些都是决策者需要回答的重要问题。