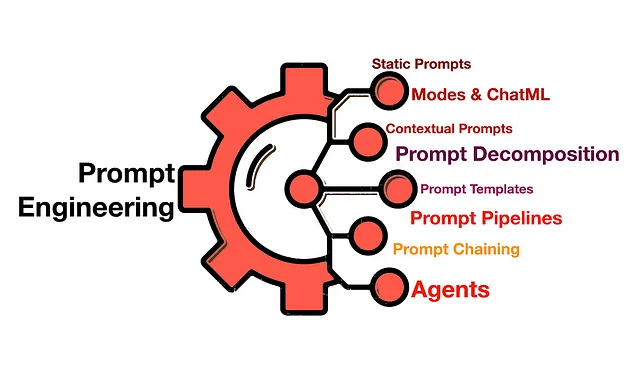

注意01 — 开发者的即时工程

主题:LLMs(大型语言模型)简介

前言

在这些故事中,我整理并整理来自视频的笔记。这系列笔记的学习来源于由安德鲁·吴和伊莎·富尔福德讲授的DLAI课程。我强烈建议您观看这一系列视频,以更好地理解概念和实践。

如果您已经知道如何使用ChatGPT,为什么不试试从学习网站下载转录并生成一个AI生成的摘要呢?😎

什么是大型语言模型(LLM)?

使用大量数据预训练的非常庞大的深度学习模型。

两种LLM类型

在LLM的开发过程中,主要有两种类型的LLM:

- 基本LLMs → 基于文本训练数据预测下一个词。

- 指令调整的LLMs → 试图遵循指令

基础 LLM

- 训练数据的来源:互联网(公开可用)

- 目的:预测最可能的后续单词。

- 示例:

Good Response:

- Prompt: Once upon a time, there was a unicorn

- Response by model: that lived in a magical forest with all her unicorn friends

[✓] Final Result: Once upon a time, there was a unicorn that lived in a magical forest with all her unicorn friends

Bad Response:

- Prompt: What is the capital of France?

- Response by model:

1. What is France's largest city?

2. What is France’s population?

3. What is the currency of France?

...

[𝗑] Final Reuslt: What is the capital of France? What is France's largest city?

✏️ 糟糕的回应分析:这个问题“法国的首都是什么?”似乎是一个简单的问题。然而,由于训练数据的来源,这个问题可能会在一篇文章中发现相同的句子,该文章可能被称为“关于法国你可能会问的50个问题(不带答案)”。

指令调校的LLM(推荐用于您的应用程序)

- 培训数据来源:步骤1.首先使用基础LLM(经过文本数据训练);步骤2.使用作为指令的输入和输出对LLM进行微调;步骤3.使用RLHF(Reinforcement Learning with Human Feedback,以人类反馈作为奖励/惩罚)进一步改进。

- 目的:通过经过调整的指令方法,LLM可以正确和恰当地做出回应,从而减少输出有问题的文本的可能性。

- 例子:

- Prompt: What is capital of France?

- Response: The capital of France is Paris.

[✓] Final Result: What is capital of France? The capital of France is Paris.

摘要

- 指导调试LLM就像一本百科全书,它知道一切并能找出解决问题的不同方法。然而,你必须提出清晰而具体的问题,以便百科全书能够搜索知识并给出答案。

- 当LLM不起作用时,有时是因为指示不够清楚。

- 示例:-提示:写一些关于勒布朗·詹姆斯(一位著名的NBA球员)的内容✏️为什么这个提示不够清晰?→这是因为提示并没有具体说明你想要写关于勒布朗的哪些具体内容或事情。是他成为一名NBA球员的故事吗?还是他现在住在哪里?

GitHub: MarsWangyang(Mars Wang)(github.com)

领英:王梦阳(火星)| 领英