人工智能时代的哲学挑战:走向有感知的人工智能

这篇文章最初是用西班牙语写的。

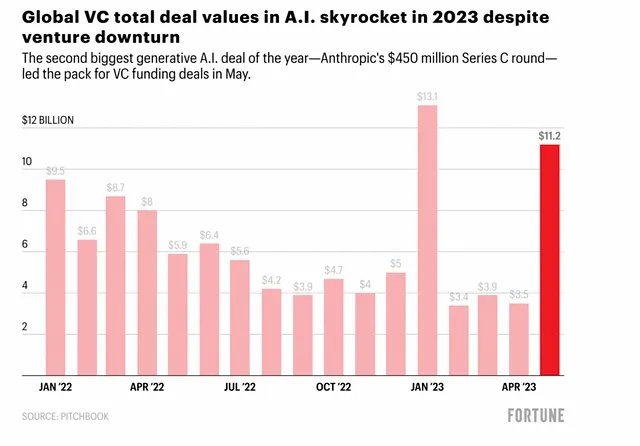

最近,人工智能(AI)和机器学习语言模型(LLM)取得了惊人的进展,改变了我们的生活,改变了我们与技术互动的方式。随着这些系统变得越来越复杂和复杂,关于它们的功能、责任和自治性的哲学和伦理问题引起了深刻的反思和多学科的方法。在本文中,我们将审查LLMs的演变和影响,如GPT-4和LLaMA,强调它们在AI伦理学中的广泛含义和它们与无器官的身体哲学的关系。此外,我们将对“对准”进行反思,以及我们在与这些新兴模型和技术的关系中面临的挑战。

注意:本文的目的并非宣称 Deleuze 和 Guattari 的无机身体(CsO)直接存在于LLM中。相反,本文的意图是利用CsO概念所激发出的某些方面和思想作为分析镜头或起点,以此来审视和反思由LLM所引发的伦理和哲学挑战。这种方法并不假定在LLM的背景下直接或文字义地解释Deleuze和Guattari的CsO,而是旨在探索和讨论CsO中的某些要素如何帮助我们批判性地和创造性地思考AI及其对我们生活的影响。

什么是出现?

“出现”是一个跨越各个学科的概念,包括生物学、物理学、化学和哲学。它指的是“较小”的系统组成部分如何相互作用,从而生成“较大”的实体。这个过程导致了超越其部分之和的性质,揭示了复杂性和新颖性,这些都无法仅通过观察单个组成部分来预测。这种出现现象可以在现实的各个层面上被识别出来,从原子相互作用到人类社会的动态,包括蚂蚁所创建的惊人结构。在机器学习语言模型(LLM)的背景下,这种现象也是存在的。如果您想了解更多关于这种现象的内容,我邀请您观看这个Kurzgesagt视频。

创造的基本组成部分

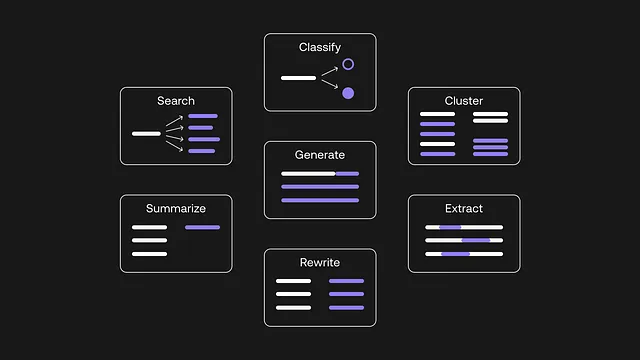

LLMs(语言模型,如 GPT-4 和 LLaMA)采用了谷歌提出的一个神经网络架构——Transformer。这个架构也是像 Dalle2 这样的技术的动力源泉。这些 Transformer 使用了一个“注意力”系统,其中给定序列中的每个单词都考虑了其他单词,以了解它的上下文。俗话说,“牛奶加巧克力”和“巧克力牛奶”不一样。因此,这些注意力模型对于理解具有复杂语法结构的语言中单词的上下文和意义是必不可少的。

现在,让我们谈论一个重要的概念,即“令牌”。 一个“令牌”可以被认为是一个意义单元。在其简单形式中,它可以是一个词,但实际上这取决于我们想要的粒度。在某些情况下,一个令牌可以是一个独立的字符,其他时候可以是一个音节,甚至是完整的单词和短语。这就是为什么用英语训练的模型可以使用其他令牌来学习西班牙语,但在另一种语言中生成它的成本可能更高,因为它需要更多的令牌来表达自己。

LLM(语言模型)被训练用来预测下一个“token”(单词)。这意味着在给定一系列的“tokens”(一个句子/提示),LLM被训练用来预测下一个“tokens”序列。这是通过数十亿的练习来完成的,我们使用从不同的互联网站提取的大型数据集来编译信息。

最后,让我们讨论另一个重要概念,那就是“参数数量”。参数基本上指的是模型“大脑”中的连接数和权重。这决定了它如何处理和生成信息。连接数越多,它就越强大,能够捕捉和生成更复杂的数据模式。

起来,我的创造,起来

正如我们所观察到的,模型中的参数数量可以使其学习和再现越来越复杂的模式,这反映在其响应的质量和复杂性上。在2020年代,这种趋势变得明显,模型扩大到之前从未见过的规模,并用其结果使我们惊讶不已。尽管它们主要是针对一个代币预测任务进行训练,但随着这些模型的扩大,新的能力从中“涌现”,例如算术、摘要创建、翻译、问题回答(QA)、逻辑推理等。随着模型规模的增加,性能在各个任务中提高,同时也解锁了新的能力。