AI目前发生的4件事

被人工智能新闻轮番侵袭?我也是。以下是值得你花时间去看的4个人工智能头条。

在2022年,关于人工智能行业的消息很少。在2023年,有了新闻热点。好吧,现在我们已经到了2024年,人工智能新闻热点已经变成了一个人工智能消防栓。人工智能的更新速度和数量令人眼花缭乱...就是来自喜欢这个东西的一个女孩的说法。

谁正在和谁做什么?...我为什么要关心?以下是值得了解的2024年人工智能新闻的4件事。

1. 谷歌推出了一款名为Gemini的人工智能语音助手。

阅读此文:谷歌发布了Gemini,一个由人工智能驱动的聊天机器人和语音助手(纽约时报,2月8日)

发生了什么:首先,我们有像Alexa、Siri这样的语音助手。然后我们得到了像ChatGPT、Bard这样的AI聊天机器人。谷歌刚刚迈出了重要的一步,推出了其新的智能手机应用程序——名为Gemini的语音AI助手。Gemini由谷歌强大的新型大语言模型(LLM)Gemini Ultra驱动。

双子座就像是亚历克斯和ChatGPT的结晶。它拥有最佳语音助手的准确性,以及多模态的人工智能聊天机器人——多模态是因为它可以阅读、理解并以文字、图像、音频或代码格式提供结果。

为什么你要在意:作为人类,我们并不仔细地按类型、格式或类别分开我们的任务。生活以一个混乱的、多模式的混合物的形式向我们展开。我对这将成为世界上第一个真正像人类助手一样行动的“助手”应用抱有很高的期望。敬请期待。

最新消息:看起来我们大多数凡人直到炫酷的孩子们已经对它失去兴趣之前,都无法使用Gemini应用程序。

2. 有一个新的AI安全联盟叫做AISIC

阅读此文:领先的人工智能公司加入安全协会以应对风险(路透社,2月7日)

发生了什么:拜登政府正在带头组织首个真正的人工智能安全联盟,共有200多个实体参与,旨在支持生成式人工智能的安全开发和部署。AISIC(即美国人工智能安全研究所联盟)会员涵盖各个行业,包括谷歌、摩根大通和Palentir等成员。

为什么你会关心:因为我们实际上并不希望选举操纵、核威胁或者人工智能统治者。现在还处于早期阶段,但这终于是朝正确方向迈出的一步。

3. AI驱动的语音自动拨号现在是非法的。

阅读此处:AI机器人电话可以欺骗选民。FCC刚刚将其定为非法。(美联社,2月8日)

发生了什么:本周,美国联邦通信委员会一致投票,禁止使用AI语音自动呼叫进行拨打电话,以试图防止利用人工智能生成“假新闻”或以任何方式干扰选举。这项规定与恶意的AI语音自动呼叫有关,其中声称是美国总统乔·拜登在新罕布什尔州发出,旨在阻止人们参加该国第一次美国总统初选投票。

你为什么在乎?

- 这是对人工智能负面影响采取积极措施的举措。美国联邦通信委员会一致通过这项决议,发出了一个强有力的积极信号,对人工智能的欺骗行为不会被容忍,尤其是与选举和政治有关的。

- 我是说...这些都是自动拨号电话。不确定是不是只有我觉得,但是最近每天我手机至少接到2个垃圾自动拨号电话。你能想象如果还有人工智能语音的自动拨号电话会怎样吗?

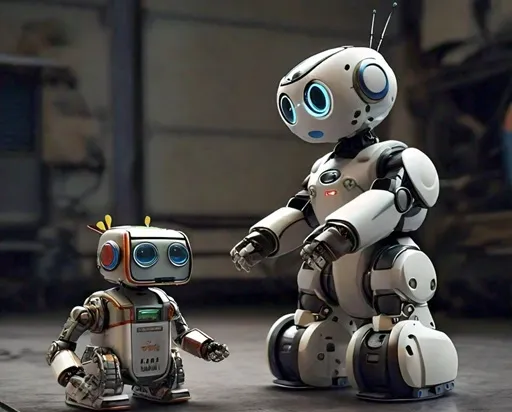

4. 你是E/acc还是E/A?是时候选边站队了。

阅读文章:《AI建设者之间的宗派分裂》(独立报,2月7日)

发生了什么:对于萨姆·奥尔特曼(Sam Altman)与他自己的OpenAI董事会之间的整个纠纷,我们大多数人感到困惑不已。他离开了!他要去微软!所有员工都要走了!哦等等...他又回来了。不管怎样。

那里到底发生了什么鬼?要理解,你需要了解一些关于两大技术运动的知识,这些运动越来越要求我们在极端哲学之间做出选择。

- E/加/速: 有效加速主义。您相信无限创新...或者至少没有监管约束。无限制的科技进步将解决几乎所有普遍的人类问题(战争、贫困、疾病、气候变化)。无限制的人工智能发展。

E/A: 有效利他主义。有效利他主义本质上是利用证据和理性寻找最有效的方法来造福他人。从解决全球贫困到消除疾病的全球问题,甚至存在AI发展造成的绝灭威胁,都需要缓慢而道德的发展人工智能和其他技术。

正如你所看到的,运动并不是根据定义而相互对立的。

更多的是,EA社区经常相信技术的快速演进通常不符合人类、地球和生命的最佳利益。而E/Acc社区通常相信无拘无束的技术发展是解决世界问题的途径。

这里还有很多要说的。想要了解有关“e/acc versus e/a”的更多信息?可以尝试这个和这个,也许这个。

为什么你会关心:我是说...如果你不关心人类和地球的未来以及世界毁灭的威胁,那么我不确定我们是否还能做朋友了。

但是说真的...你之前听我说过:科技正在进行关于人类未来的辩论,可你并未参与其中。我无法表达出我们多么需要你的声音、专业知识和经验。先学习好自己,然后参与进来。这可能听上去有些玄奥,但我向你保证,这些运动正在塑造我们与人工智能共同的未来。相当重要。

哦等一下!我忘了说了,这与Sam Altman和OpenAI有什么关系?还有更多的要说,但基本上,OpenAI的领导层分为派系:开除了Altman的董事会主要是E/A,他们视他为日益威胁的E/acc类型。待续。

这对我来说是一个很好的项目,也让我能读到新闻标题。OK,Technormalists,我们再来一次吧?